Smartphone basé Motion-ui possible dans l'année avec Leap Motion

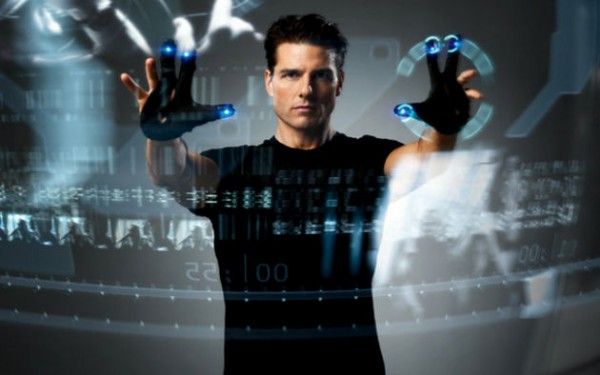

Très bientôt, nous pouvons contrôler nos ordinateurs, tablettes et smartphones de cette façon. Sans les gants à trois doigts, bien sûr. (L'image promotionnelle pour Minority Report, 2002)

Les écrans tactiles sont actuellement le moyen le plus pratique d'interagir avec smarphones et tablettes. Mais les appareils mobiles sont beaucoup évolution rapide, et nous avons vu comment les claviers QWERTY, stylii et même des claviers numériques ont été des choix de l'interface utilisateur populaires à quelques années en arrière.

Alternatives à écran tactile sont déjà en place, telles que la reconnaissance vocale présente dans le Siri Apple et divers Efforts de Nuance-conduit dans Android et d'autres plateformes. Dans l'avenir, nous pourrions également envisager la commande de mouvement. Pensez-y comme Minority Report manipulation de style des objets virtuels sur l'écran.

Oh attends. Nous avons déjà cela avec Microsoft Kinect, non? Kinect a été principalement commercialisé pour la console de jeu, mais une variante sur ordinateur est disponible. Mais ce qui manque à ce point sont des interfaces utilisateur qui marchent et qui en fait se contrôle du mouvement des moyens productifs de la manipulation des données.

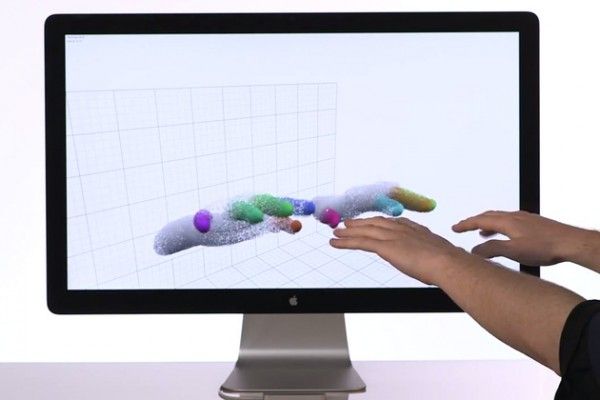

Espaces de travail 3D

Il ya un développement par une compagnie appelée Leap Motion, qui a créé un dispositif connu sous le nom The Leap. La technologie utilise plusieurs capteurs de l'appareil photo en traçant un espace de travail tridimensionnel pour le suivi de mouvement. Le pari n'a pas les limites de Kinect de distance et l'angle de vue. Au lieu de cela, le dispositif peut suivre le mouvement aussi longtemps que l'utilisateur est en vue des capteurs. Ce qui est formidable est que le dispositif est très précis, et peut suivre le mouvement vers le bas pour un centièmes de millimètre, soit environ la moitié du diamètre d'un cheveu humain. Il peut aussi distinguer entre les différents objets et parties du corps.

Actuellement, le pari est un dispositif de la taille d'une clé USB, et les caméras VGA sont limités à un huit pieds cubes espaces de travail (0,22 mètres cubes) - environ le volume d'un petit réfrigérateur à moyen. La technologie peut être mise à l'échelle, cependant, de telle sorte que la taille de l'espace de travail est limité seulement au champ de vision. Je suppose que Leap Motion peut capturer le mouvement dans les zones plus grandes comme des champs entiers et des chambres.

Mais la petite taille a un avantage. Il peut être intégré dans les appareils mobiles comme les ordinateurs portables, smartphones et tablettes. Leap travaille déjà avec des fabricants d'appareils en incluant éventuellement la technologie sur leurs produits. Leap donne également des capteurs gratuits à des milliers de développeurs qualifiés "" dans le but de construire une bonne base de l'application pour le système.

La société affirme que le coût de l'appareil sera de 70 $ quand il sortira quelque part entre Décembre de cette année à Février 2013. Les utilisateurs intéressés peuvent déjà pré-commander.

Minority Report

Leap est plus que la capture simplement basé sur le mouvement, cependant. CTO de l'entreprise, David Holz, dit que la technologie basée sur le mouvement ne devrait pas forcer les utilisateurs d'avoir à mémoriser les gestes et de mouvements dans la combinaison d'accéder aux données. Au lieu de cela, les développeurs sont encouragés à fournir une rétroaction dynamique constante. Cela signifie que l'interface doit être intuitif et assez réactif que l'utilisateur ne devrait pas avoir à se demander comment l'utiliser.

Par exemple, l'analogie pinch-to-zoom est assez explicite. Ainsi se tourne un objet à tourner. Le but ici est de faire l'interface utilisateur comme semblable à la manipulation d'objets du monde réel que possible.

Une fois sorti, Leap devrait permettre de manipuler des objets se déplaceront vos mains et vos doigts dans l'air, ou même le long d'une surface. Ce type de technologie a effectivement été explorée par Apple, et la compagnie a même déposé un brevet qui détecte les mouvements sur un écran sans avoir besoin de capacité.

En tant que tel, nous pourrions bientôt prévoyons être en mesure de contrôler nos appareils même sans les toucher. Nous pouvons peut-être annuler ou de répondre aux appels en balayant nos mains en l'air. Nous pouvons également être en mesure de poser le téléphone pour lire des messages par un autre mouvement de la main.

Ajoutez à cela avec des technologies comme lunettes Google, et nous nous avons un avenir de l'informatique comme le système de Tom Cruise sur Minority Report. Espérons juste que cela ne conduise pas à la précognition de crime ou nous sommes tous foutus.

Découvrez la vidéo de démonstration ci-dessous.